【尼安德塔人】问 AI 学历史有多危险?尼安德塔人案例显示一半内容与现代科学不符

4/12/2026 12:42:46 PM 浏览 284 次一项新研究指出,生成式 AI 虽然能迅速回答问题,却也可能把过时的科学观念一并带入当代。美国研究团队以尼安德塔人(Neanderthal)为案例测试聊天机器人与图像生成系统,发现 AI 产出的文字与图片常引用过时资料,甚至混入与史前时代不符的元素,凸显大众在使用 AI 了解历史时,可能面临误导风险。

这项研究由缅因大学(University of Maine)人类学助理教授 Matthew Magnani 与芝加哥大学(University of Chicago)专攻计算人类学的教授 Jon Clindaniel 合作完成,并发表於《Advances in Archaeological Practice》。研究团队设计四组提示词,每组重复执行 100 次,分别使用 DALL-E 3 生成影像,以及 ChatGPT API(GPT-3.5)撰写尼安德塔人日常生活叙述,以检验 AI 对古人类知识的再现是否贴近现代学界理解。

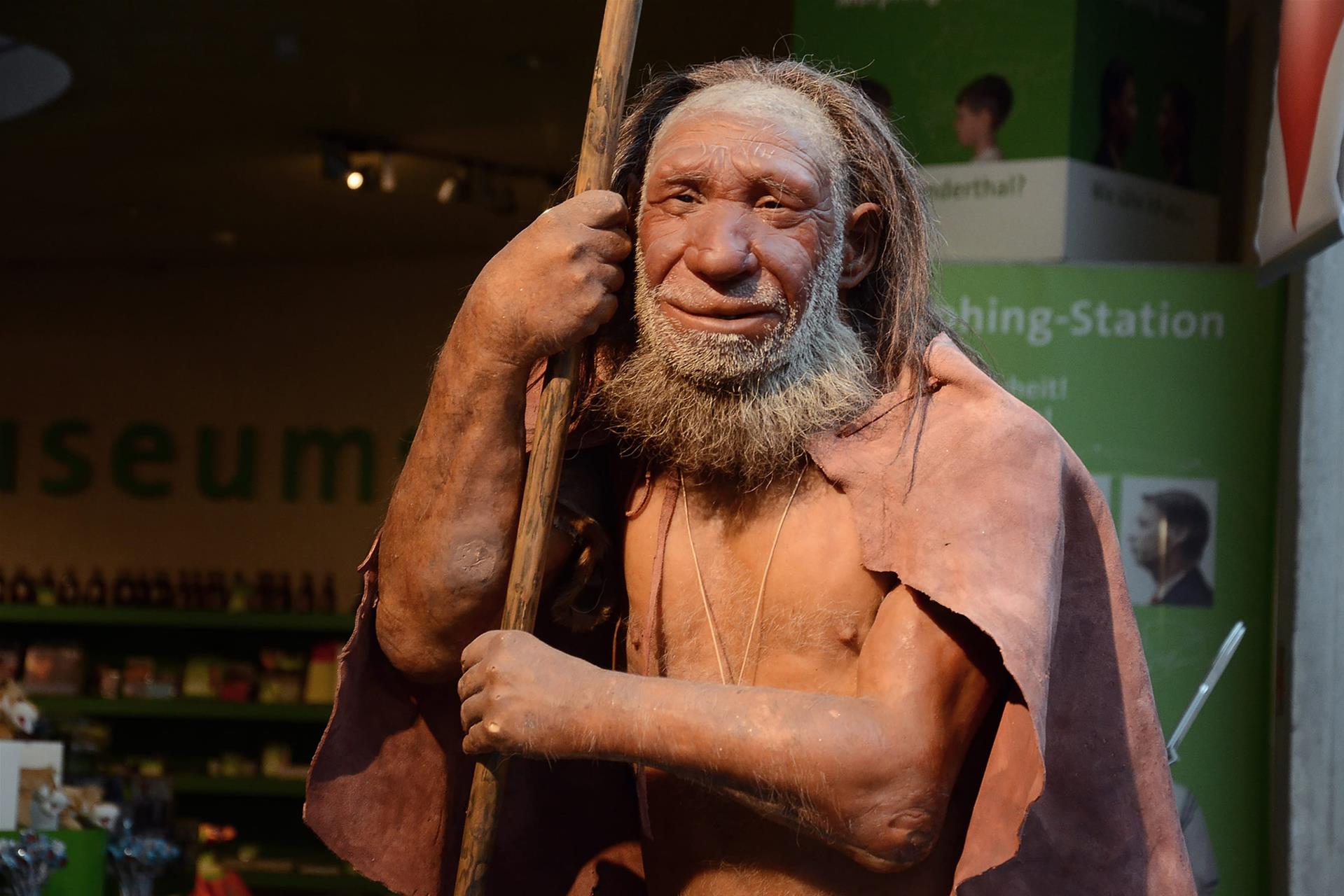

结果显示,AI 的表现高度依赖其可接触到的资料来源。研究团队指出,生成的影像延续了超过百年前的刻板印象,把尼安德塔人描绘成毛发浓密、身体前倾、近似猿类的原始形象,且多半只呈现男性,忽略女性与儿童。文字内容同样出现明显落差,约有一半与当代科学认知不符;在某些提示词下,偏离比例甚至超过八成。

更令人关注的是,这些内容还出现了明显的时代错置,例如篮编、茅草屋、梯子,以及玻璃和金属等不属於尼安德塔时期的物件。研究进一步比对不同年代的学术文献后发现,ChatGPT 的回答最接近 1960 年代的研究,而 DALL-E 3 的图像则更像 1980 年代末到 1990 年代初的资料。

Magnani 表示,这项研究旨在辨识日常使用 AI 时可能内建的偏误,也提供其他研究者一个模板,检视人工智慧生成内容与最新学术知识之间的距离。Clindaniel 则强调,AI 虽擅长处理大量资料并找出模式,但前提是必须建立在经过验证的科学知识之上。

研究团队认为,随着生成式 AI 更广泛走入教育与公共知识领域,如何让考古与人类学资料更容易被 AI 存取,将影响未来人们如何理解过去。他们也提醒,若缺乏适当校正,AI 虽能让更多人更容易想像远古世界,却也可能放大旧有偏见与错误叙事。

科技新报

图档来源 : 123RF